En 2023, Google a prélevé 28 milliards de litres d’eau. Un chiffre astronomique qui soulève une question simple : comment une technologie que l’on perçoit comme immatérielle, l’intelligence artificielle, peut-elle avoir une soif si concrète et démesurée ? La réponse n’est pas dans le cloud, mais bien sur terre, au cœur d’une chaîne de causalité physique implacable. L’IA a une empreinte hydrique, et elle est bien plus importante que ce que les entreprises de la tech laissent paraître. Cet article décortique le mécanisme qui transforme l’électricité en chaleur, et la chaleur en vapeur d’eau, pour comprendre pourquoi l’IA consomme beaucoup d’eau et ce que cela signifie pour nos ressources.

Les infos à retenir (si vous n’avez pas le temps de tout lire)

- 💧 La raison principale est le refroidissement : les serveurs qui font tourner l’intelligence artificielle génèrent une chaleur intense que l’eau, bien plus efficace que l’air, permet de dissiper.

- 🏭 Il existe deux types de consommation : la consommation directe (eau évaporée sur le site des centres de données) et la consommation indirecte (eau utilisée pour produire l’énorme quantité d’électricité nécessaire).

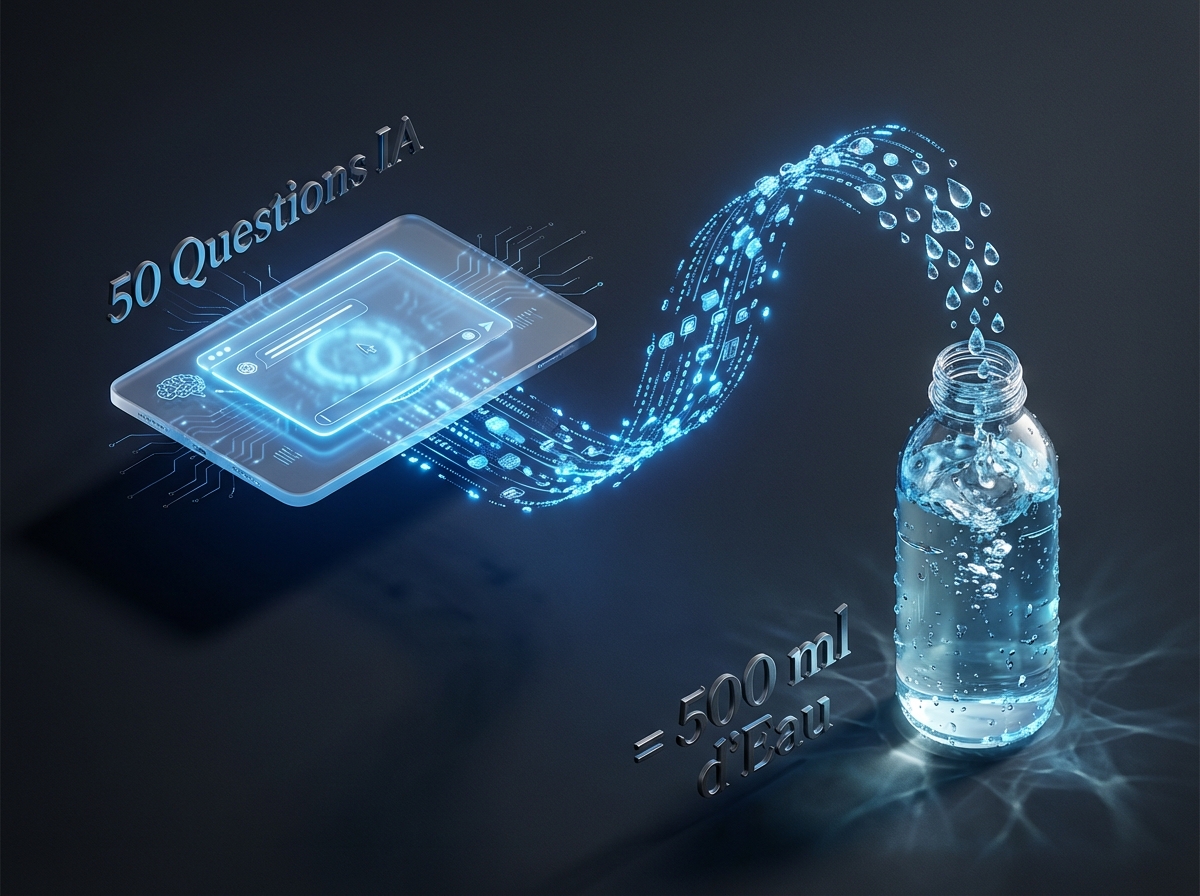

- Bouteille d’eau : Une conversation de 10 à 50 questions avec une IA comme ChatGPT peut engloutir l’équivalent d’une bouteille d’eau de 500 ml.

- 🏋️♂️ Il faut distinguer l’entraînement (phase initiale très gourmande, comme les 700 000 litres pour GPT-3) de l’inférence (l’usage quotidien, moins intensif par requête mais massivement répété).

- L’eau « prélevée » par un centre de données n’est pas entièrement perdue. Une partie circule en circuit fermé, mais la part « consommée » est celle qui s’évapore et disparaît de la source locale.

Le mécanisme thermique : De la chaleur du serveur à l’évaporation dans les tours

Au cœur du problème se trouve une loi physique fondamentale : toute l’énergie électrique qui alimente un processeur (GPU), comme ceux des supercalculateurs IA massifs, pour faire tourner une IA est presque entièrement convertie en chaleur. C’est l’effet Joule. Sans un système de refroidissement efficace, ces puces surchaufferaient et cesseraient de fonctionner en quelques secondes. C’est là que l’eau entre en jeu.

L’eau possède une capacité thermique bien supérieure à celle de l’air. Cela signifie qu’elle peut absorber et transporter de grandes quantités de chaleur beaucoup plus efficacement. Dans les centres de données, des circuits d’eau froide passent à travers des échangeurs thermiques pour capter la chaleur des serveurs. Cette eau, désormais chaude, est ensuite acheminée vers d’immenses tours de refroidissement.

Le principe est celui du refroidissement adiabatique : l’eau chaude est pulvérisée en fines gouttelettes. Une petite fraction de cette eau s’évapore, et ce changement d’état physique (de liquide à gaz) absorbe une énorme quantité d’énergie thermique, refroidissant ainsi le reste de l’eau qui peut alors retourner dans le circuit pour capter à nouveau la chaleur des serveurs. C’est ce processus d’évaporation qui constitue la consommation d’eau directe.

Il est ici capital de faire une distinction technique que les rapports omettent souvent. Le « prélèvement » est le volume total d’eau qui entre dans le circuit de refroidissement. La « consommation », elle, ne désigne que la part de cette eau qui est réellement perdue par évaporation et qui ne retourne pas à sa source locale. C’est cette consommation qui a un impact direct sur les ressources hydriques d’une région.

L’eau visible et l’eau cachée : La double empreinte hydrique de l’IA

La consommation d’eau de l’intelligence artificielle ne se limite pas à ce qui s’évapore des tours de refroidissement. L’empreinte hydrique totale est double, composée d’une part visible et d’une part cachée, souvent bien plus importante.

La consommation directe : L’eau évaporée sur le site du data center

C’est la partie la plus évidente de l’iceberg. L’eau utilisée pour le refroidissement des serveurs, comme décrit précédemment, représente des volumes colossaux. Un grand centre de données peut consommer, selon les estimations de l’Université de Californie à Riverside, entre 11 et 19 millions de litres d’eau par jour. Pour donner un ordre de grandeur, le rapport environnemental de Google pour 2023 indique que les deux tiers de ses 28 milliards de litres d’eau prélevés cette année-là étaient destinés au refroidissement de ses data centers.

Cette demande massive en eau peut créer un stress hydrique local significatif, notamment lorsque ces infrastructures sont implantées dans des régions déjà sujettes à la sécheresse. L’exemple de Microsoft aux Pays-Bas, qui a consommé 84 millions de litres en 2021, soit jusqu’à 7 fois plus que prévu, illustre l’impact local que peuvent avoir ces centres de données.

La consommation indirecte : L’empreinte hydrique de la production électrique

C’est la face cachée de la consommation d’eau de l’IA. Pour fonctionner, les milliers de serveurs d’un data center ont besoin d’une quantité phénoménale d’électricité. Or, la production de cette électricité a elle-même une empreinte hydrique massive. Les centrales thermiques (nucléaires, gaz, charbon) qui alimentent le réseau électrique fonctionnent sur un principe similaire : de l’eau est chauffée pour créer de la vapeur qui fait tourner des turbines. Cette vapeur doit ensuite être refroidie, souvent via des tours de refroidissement qui, elles aussi, consomment de l’eau par évaporation.

L’étude « Patterns » de décembre 2025, menée par l’expert Alex de Vries-Gao, est l’une des premières à intégrer cette dimension. Ses conclusions sont sans appel : la consommation d’eau indirecte peut être jusqu’à quatre fois supérieure à la consommation directe sur site. C’est un facteur multiplicateur énorme, largement ignoré dans les bilans communiqués par les entreprises du secteur, qui se concentrent uniquement sur leur consommation directe.

Du modèle à l’utilisateur : Le coût en eau d’une conversation avec l’IA

Traduire ces milliards de litres en un coût tangible pour l’utilisateur final permet de mieux saisir l’échelle du problème. L’impact hydrique de l’IA se décompose en deux phases distinctes : l’entraînement du modèle et son utilisation quotidienne.

Phase d’entraînement : Une soif initiale pour la connaissance

L’entraînement d’un grand modèle de langage est un processus ponctuel mais d’une intensité extrême. Pendant des semaines, des milliers de processeurs tournent à plein régime pour « apprendre » à partir de gigantesques volumes de données massives. Cette phase de calcul intensif génère une chaleur colossale et donc une demande en refroidissement particulièrement élevée.

Le chiffre de référence, issu d’une étude de l’Université de Californie, est celui de l’entraînement de GPT-3. Cette seule opération aurait nécessité environ 700 000 litres d’eau dans les centres de données de Microsoft. C’est l’équivalent de la production de 370 voitures électriques ou de 320 Tesla. Une soif initiale qui pose les bases de l’empreinte hydrique du modèle pour toute sa durée de vie.

Phase d’inférence : Le coût de chaque requête au quotidien

La phase d’inférence correspond à l’utilisation de tous les jours : chaque fois que vous posez une question à ChatGPT ou générez une image avec une IA. Si chaque requête est moins gourmande que l’entraînement, leur volume (plus d’un milliard par jour pour ChatGPT) crée un impact cumulé gigantesque. Les estimations varient fortement selon le périmètre de l’analyse, comme le montre le tableau suivant.

| Modèle / Scénario | Consommation d’eau estimée | Périmètre de l’étude | Source |

|---|---|---|---|

| 1 requête à Gemini | 0,26 ml | Refroidissement direct uniquement | Google (2024) |

| Une conversation de 20-50 questions avec ChatGPT | ~ 0,5 litre | Inclut le refroidissement direct sur site | Étude « Making AI Less ‘Thirsty' » (UCR, 2023) |

| Une conversation de 10-50 requêtes (modèles performants) | Jusqu’à 2 litres | Approche large incluant l’entraînement | DRANE Versailles (2025) |

L’analogie la plus parlante est celle de la bouteille d’eau. Selon l’étude de référence de l’UCR, une simple conversation avec une intelligence artificielle peut vous coûter l’équivalent d’une bouteille de 500 ml. Un coût invisible mais bien réel à chaque interaction.

Mesurer pour réduire : Le WUE et les pistes pour une IA plus sobre

Face à cette soif croissante, l’industrie des data centers n’est pas sans réponse. Pour mesurer et améliorer leur efficacité, les opérateurs utilisent une métrique standard : le WUE (Water Usage Effectiveness). Cet indicateur, qui se calcule simplement en Litres par kilowatt-heure (L/kWh), permet de quantifier la performance hydrique d’un centre de données. L’objectif est de réduire ce ratio au maximum, c’est-à-dire d’utiliser le moins de litres d’eau possible pour chaque unité d’énergie consommée par les serveurs.

Plusieurs pistes technologiques et stratégiques sont explorées par les entreprises pour réduire leur consommation et améliorer leur WUE :

- L’optimisation des algorithmes : Rendre les modèles d’IA plus efficaces permet de réduire le nombre de calculs nécessaires, et donc l’énergie et le refroidissement requis.

- La localisation géographique : Implanter des centres de données dans des régions plus froides permet d’utiliser l’air extérieur pour le refroidissement (« free cooling ») une grande partie de l’année, limitant le recours à l’eau.

- Les systèmes en circuit fermé : Ces technologies permettent de refroidir l’eau sans évaporation, éliminant ainsi la consommation directe, mais ils sont plus coûteux et moins efficaces thermiquement.

- Le recyclage et le traitement de l’eau : Des entreprises comme Veolia développent des systèmes de traitement sur site qui permettent de réutiliser les eaux usées pour le refroidissement, pouvant réduire la consommation d’eau neuve de 50%.

- L’IA au service de l’IA : Utiliser des modèles d’intelligence artificielle pour optimiser en temps réel la gestion thermique des serveurs, en ajustant le refroidissement au plus près des besoins.

La consommation d’eau de l’intelligence artificielle n’est pas une fatalité, mais un défi d’ingénierie majeur lié à la gestion thermique. Le véritable enjeu est celui de la transparence. Tant que les géants de la tech ne publieront pas de manière systématique et vérifiable leurs données de consommation, directe et indirecte, et leurs métriques comme le WUE, il sera difficile de mesurer les progrès réels. Le développement d’une IA durable sur le plan hydrique passe par l’innovation technologique, mais aussi et surtout par une obligation de rendre des comptes sur l’impact réel de cette technologie sur nos ressources les plus précieuses.

Questions fréquentes

Combien de litres d’eau consomme une simple question à ChatGPT ?

Les estimations varient. Une étude de l’Université de Californie Riverside évalue qu’une conversation de 20 à 50 questions consomme environ 500 ml d’eau, soit l’équivalent d’une petite bouteille. D’autres estimations plus larges, incluant l’impact de l’entraînement du modèle, peuvent monter jusqu’à 2 litres pour 10 à 50 requêtes.

Quelle est la différence entre l’eau ‘prélevée’ et l’eau ‘consommée’ par un data center ?

L’eau « prélevée » est la quantité totale d’eau pompée d’une source (rivière, nappe phréatique) pour entrer dans le circuit de refroidissement. L’eau « consommée » est la fraction de cette eau qui est perdue, principalement par évaporation dans les tours de refroidissement, et qui n’est donc pas restituée au milieu naturel. La consommation a un impact direct sur les ressources locales, tandis qu’une grande partie de l’eau prélevée peut être retournée à sa source.

Pourquoi les data centers n’utilisent-ils pas simplement la climatisation à air ?

La climatisation à air est beaucoup moins efficace pour évacuer les énormes quantités de chaleur générées par des milliers de serveurs concentrés dans un petit espace. L’eau a une capacité thermique bien plus élevée, ce qui signifie qu’elle peut absorber et transporter la chaleur plus efficacement et avec une consommation d’énergie moindre que les systèmes à air pour des installations de cette taille. C’est un choix d’efficacité thermodynamique et énergétique.